Facebooks algoritmer kan plukke dit ansigt ud af en mængde (eller i det mindste prøve), men det kan stadig ikke se, om du poserer i et familieportræt eller drikker med venner - det kan ikke fortælle dig, hvordan du interagerer med andre . I fremtiden kan computere muligvis gøre netop det. Nu har forskere foreslået en måde at finde ud af, hvordan smart computere er i visuel identifikation. De kalder deres test for en visuel Turing-test efter computerforskeren Alan Turing's test om, hvorvidt en computer kan vise menneskelignende intelligens.

Den populære opfattelse af testen er, at den bruges til at skelne mennesker fra computere - og en version bruges til det, når du foretager en CAPTCHA for at tilmelde dig en ny e-mail. Men kunstige intelligensforskere tænker virkelig på testen som en måde at måle, hvor avanceret computerintelligens er hidtil.

”Der har været nogle imponerende fremskridt inden for computervision i de senere år, ” siger Stuart Geman, en matematikprofessor ved Brown University og en af forskerne, der foreslår den nye evaluering, i en pressemeddelelse. ”Vi følte, at det måske var på tide at hæve søjlen med hensyn til, hvordan disse systemer evalueres og benchmarkes.”

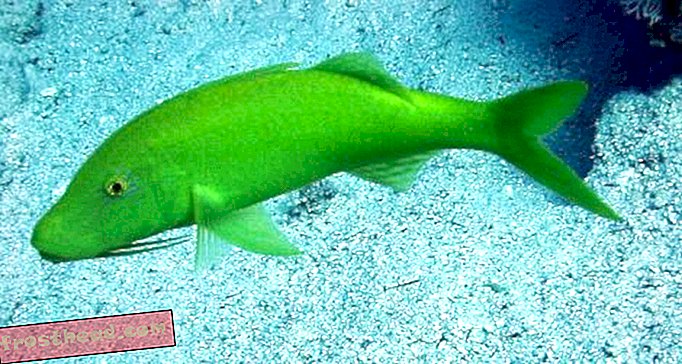

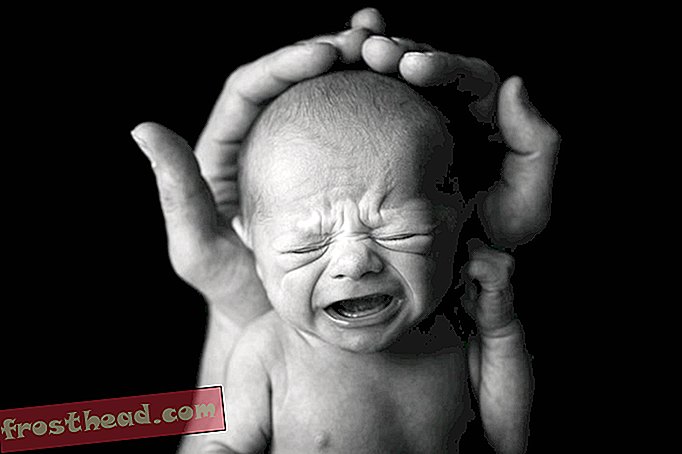

I stedet for blot at erkende, at et billede viser to personer, ser testen, om computere kan finde ud af, at de to personer har en samtale eller endda et argument. I øjeblikket bruger forskere offentligt tilgængelige datasæt til at teste deres programmer — MIT har LableMe, der bruger crowddsourcing til at identificere “bilen”, “træet” og “bygningen” på f.eks. Billeder. For at forbedre dette og tilbyde en større udfordring kom forskere, der er hjemmehørende i Brown, med en ramme for en standardiseret visuel Turing-test.

Lee Gomes til IEEE Spectrum rapporter:

Deres foreslåede metode opfordrer menneskelige testdesignere til at udvikle en liste over visse attributter, som et billede kan have, som om en gadescene har mennesker i sig, eller om folket bærer noget eller snakker med hinanden. Fotografier blev først håndskåret af mennesker på disse kriterier; et computersynssystem ville derefter blive vist det samme billede uden ”svarene” for at afgøre, om det var i stand til at vælge, hvad menneskerne havde set.

Oprindeligt ville spørgsmålene være rudimentære og spørge, om der f.eks. Er en person i en udpeget region på billedet. Men spørgsmålene voksede i kompleksitet, efterhånden som programmer blev mere sofistikerede; et mere kompliceret spørgsmål kan omfatte arten af en interaktion mellem forskellige mennesker på billedet.

Holdet beskrev testen i Proceedings of the National Academy of Sciences . I øjeblikket siger tyskeren, at intet computersystem ikke kunne bestå selv de enkle versioner af den nye test. Men de vil i fremtiden. Da der er mange mulige attributter til ethvert foto, er forskere nødt til at komme med innovative måder for deres computere at lære at vurdere fotos.

”Som forskere har vi en tendens til at” undervise i testen, ”siger Geman i erklæringen. ”Hvis der er visse konkurrencer, som alle går ind i, og det er målene for succes, så er det, hvad vi fokuserer på. Så det kan være klogt at ændre testen og sætte den lige uden for rækkevidde af de nuværende synssystemer. ”