Da John Brennan, præsident Obamas valg om at være den næste leder af CIA, dukkede op for et senatudvalg i går, erstattede et spørgsmål alle andre ved hans konfirmationshøring:

Hvordan træffes beslutningerne om at sende dræber dronere efter mistanke om terrorister?

Hvordan og, for den sags skyld, hvorfor man bestiller specifikke drone-strejker forbliver stort set et mysterium, men i det mindste en ting er klar - beslutningerne tages af mennesker, som man håber, kæmper med tanken om at sende et dødbringende missil ind i en besat bygning.

Men hvad nu hvis mennesker ikke var involveret? Hvad hvis en dags beslutninger om liv eller død blev overladt til maskiner udstyret med masser af data, men også en følelse af rigtigt og forkert?

Moralsk kvarter

Det er ikke hidtil hentet. Det vil ikke ske nogen tid snart, men der er ingen tvivl om, at når maskiner bliver mere intelligente og mere autonome, vil en vigtig del af deres transformation være evnen til at lære moral.

Faktisk er det måske ikke så langt væk. Gary Marcus, der for nylig skrev i The New Yorker, præsenterede scenariet for en af Googles førerløse biler, før han blev tvunget til at træffe en split-sekund-beslutning: ”Din bil kører med en hastighed langs en bro på 50 miles i timen, når der skabes skolebuss med 40 uskyldige børn krydser sin vej. Skal din bil svæve og muligvis risikere dens ejer (dig) levetid for at redde børnene eller fortsætte med at sætte alle 40 børn i fare? Hvis beslutningen skal træffes i millisekunder, bliver computeren nødt til at foretage opkaldet. ”

Og hvad med robotvåben eller soldater? Ville en drone være i stand til at lære at ikke skyde på et hus, hvis den vidste, at uskyldige civile også var inde? Kan maskiner læres at følge de internationale krigsregler?

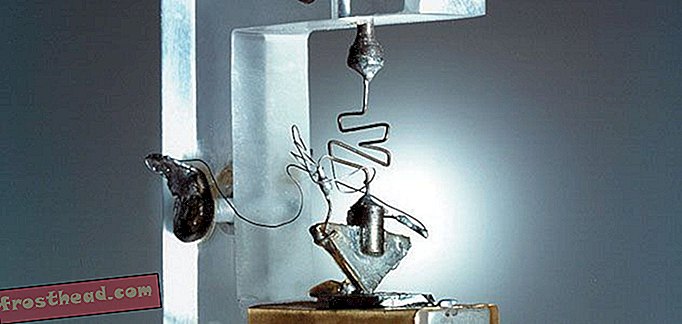

Ronald Arkin, en computer videnskabsprofessor og robotik ekspert ved Georgia Tech, synes bestemt det. Han har udviklet software, kaldet en "etisk guvernør", der ville gøre maskiner i stand til at beslutte, hvornår det er passende at skyde, og hvornår det ikke er tilfældet.

Arkin erkender, at dette stadig kan være flere årtier væk, men han mener, at robotter en dag måske er både fysisk og etisk overlegne overfor menneskelige soldater, ikke sårbare over for det følelsesmæssige traume ved kamp eller ønsker om hævn. Han forestiller sig ikke en all-robot-hær, men en, hvor maskiner tjener sammen med mennesker, der udfører højrisikojob fuld af stressende snap-beslutninger, såsom at rydde bygninger.

Pas på mordererobotter

Men andre føler, at det er tid til at sprænge denne form for tankegang, før det går for langt. I slutningen af sidste år udstedte Human Rights Watch og Harvard Law Schools menneskerettighedsklinik en rapport, ”Losing Humanity: The Case Against Killer Robots, ” som, troet på dens titel, opfordrede regeringerne til at forbyde alle autonome våben, fordi de ville ”øge risiko for død eller personskade under væbnede konflikter. ”

Omtrent på det samme tidspunkt annoncerede en gruppe professorer fra Cambridge University planer om at lancere det, de kalder Center for Study of Existential Risk. Når det åbnes senere i år, vil det skabe alvorlig videnskabelig forskning i, hvad der kan ske, hvis og når maskiner bliver smartere end os.

Faren, siger Huw Price, en af centrets medstiftere, er, at vi en dag kunne beskæftige os med “maskiner, der ikke er ondsindede, men maskiner, hvis interesser ikke inkluderer os”.

Kunsten at bedrag

Shades of Skynet, det useriøse kunstige intelligenssystem, der gød en cyborg Arnold Schwarzenegger i The Terminator- film. Måske vil dette altid være tingene i science fiction.

Men overvej anden forskning, som Ronald Arkin nu udfører som en del af projekter, der finansieres af Department of Defense. Han og kolleger har undersøgt, hvordan dyr bedrager hinanden med det formål at lære robotter kunsten at bedrag.

For eksempel har de arbejdet med programmering af robotter, så de om nødvendigt kan føle styrke som dyr ofte gør. Og de har set på undervisningsmaskiner til at efterligne adfærd hos væsener som det østlige grå egern. Ekorn skjuler deres nødder for andre dyr, og når andre egern eller rovdyr dukker op, vil de grå egern undertiden besøge steder, hvor de plejede at skjule nødder for at kaste deres konkurrenter væk fra banen. Robotter, der er programmeret til at følge en lignende strategi, har været i stand til at forvirre og bremse konkurrenterne.

Det handler i interesse, siger Arkin, om at udvikle maskiner, der ikke vil være en trussel for mennesker, men snarere et aktiv, især i krigens grimme kaos. Nøglen er at begynde at fokusere nu på at indstille retningslinjer for passende robotadfærd.

”Når du begynder at åbne denne Pandora's Box, hvad skal der gøres med denne nye kapacitet?” Sagde han i en nylig samtale. ”Jeg tror, at der er et potentiale for, at ikke-stridende tab skal mindskes af disse intelligente robotter, men vi er nødt til at være meget omhyggelige med, hvordan de bruges, og ikke bare frigive dem til slagmarken uden passende bekymring.”

For at tro New Yorker- forfatter Gary Marcus tilbyder etisk avancerede maskiner et stort potentiale ud over slagmarken.

Den tanke, der hjemsøger mig mest, er, at den menneskelige etik i sig selv kun er et arbejde, der er i gang. Vi konfronterer stadig situationer, hvor vi ikke har veludviklede koder (f.eks. I tilfælde af assisteret selvmord) og behøver ikke kigge langt ind i fortiden for at finde tilfælde, hvor vores egne koder var tvivlsomme eller værre (f.eks. Love, der tilladt slaveri og adskillelse).

Det, vi virkelig ønsker, er maskiner, der kan gå et skridt videre, udstyret ikke kun med de mest sunde etiske kodekser, som vores bedste nutidige filosoffer kan udtænke, men også med muligheden for, at maskiner gør deres egen moralske fremgang, og bringer dem forbi vores egne tidlige -tyvende århundrede idé om moral. ”

Maskiner marcherer videre

Her er en nyere robotudvikling:

- Hmmmm, etisk og lusket: Forskere i Australien har udviklet en robot, der kan snige sig ved kun at bevæge sig, når der er nok baggrundsstøj til at dække sin lyd.

- Hvad er den summende lyd ?: Britiske soldater i Afghanistan er begyndt at bruge overvågningsdroner, der kan passe i håndfladerne. Den lille robot kaldes Black Hornet Nano og er kun fire tommer lang, men har et spionkamera og kan flyve i 30 minutter på fuld opladning.

- Skraber overfladen: NASA udvikler en robot kaldet RASSOR, der vejer kun 100 pund, men vil være i stand til at udvinde mineraler på månen og andre planeter. Det kan bevæge sig rundt i ujævnt terræn og endda over fedthed ved at støtte sig selv på armene.

- Ah, lyst: Og her er en tidlig Valentinsdagshistorie. Forskere ved universitetet i Tokyo brugte en mandemøl til at køre en robot. Faktisk brugte de parringernes bevægelser til at rette enheden mod et objekt, der er parfumeret med kvindelige malferomoner.

Videobonus: Så du er bare ikke sikker på, at du kunne betjene en 13-fots høj robot? Intet problem. Her er en fin demonstration, der viser dig, hvor let det kan være. En glad model viser dig endda, hvordan du bruger funktionen “Smile Shot”. Du smiler, det fyrer BBs. Hvor hårdt er det?

Mere fra Smithsonian.com

Denne robot er en bedre far end din far

Robotter Få det menneskelige touch